快速对话

Baicai Infer(白菜AIGC)提供了「模型对话」功能,其操作简单直接,并且内置了Qwen3-32B、Qwen3-8B、DeepSeek-R1-Distill-Qwen-1.5B、Qwen2.5-VL-32B-Instruct等一批顶尖模型,可以快速完成对话任务。本文介绍如何快速发起模型对话。

前提条件

- 已登录Baicai Infer官网,具体可参考短信注册/登录完成登录。

- 当前账号的余额充裕,可满足模型推理服务的需要。可通过账户充值页面,为您的账户进行充值,如需了解更多请联系我们。

操作步骤

-

单击左侧导航栏的「创作 > 对话」。

-

选择模型,并设置相关参数。

-

选择模型:选择模型

Qwen3-32B(如图①)。支持的模型,具体可参考模型和应用列表。 -

设置生文参数(如图②),具体的参数配置(如图③),参数说明如下表。

参数 说明 示例 System Prompt System Prompt是一个用于控制模型生成结果的指令,通常会以 '### Instruction:' 开头,后面是模型需要生成的内容。 - Temperature 用于调控大模型的随机性与确定性,取值越低输出越具确定性,取值越高输出越具多样性。 0.95 Top-P 控制生成时候选token集合大小的参数,取值越大生成的随机性,取值越小结果越稳定。 0.7 Top-K 在模型的输出中选择概率最高的前K个结果,保证问答结果的合理性,同时提升结果的多样性。取值越大越创造性越高,取值越小准确性越高。 50 Max Tokens 模型输出的最大token数量,输入token和输出token的总长度还受模型的上下文长度限制。 1024 Frequency Penalty 重复惩罚用于控制词语重复频率,通过降低高频词的出现概率提升结果多样性。 0

-

-

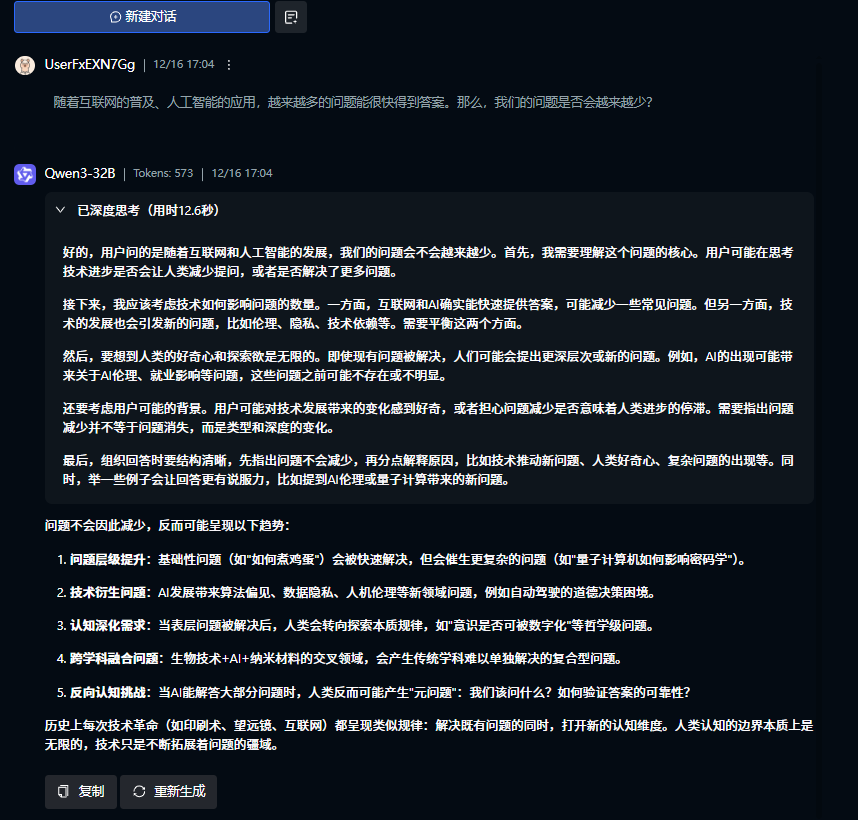

在提示词区域输入文本问题(如上图④),示例:

随着互联网的普及、人工智能的应用,越来越多的问题能很快得到答案。那么,我们的问题是否会越来越少?- 「提示词优化」按钮默认开启(如上图⑤),即可自动优化提示词。

- 单击「翻译」按钮(如上图⑥),可实现中英文互译。

-

单击右下角的「生成」按钮(如上图⑦),生成文本。

生成结果:

-

复制保存生成的文本内容。

您可以单击文本下方的「复制」按钮,粘贴保存文本至本地。

-

单击「重新生成」按钮,可重新生成新的推理内容。